Tsja, auto’s, ‘artificial intelligence’ en security: Het is het bekende verhaal. Nog steeds … Zijn er technologische of andere ontwikkelingen de afgelopen halve eeuw waarbij security-in-brede-zin nou eens echt vanaf het begin is meegenomen, of blijven we met alle OT-dingen om ons heen doorgaan met de put dempen, security er een beetje (sic) opschroeven als het al te laat is?

Bij auto’s is dat ook het geval. Met als complicatie dat we niet alleen snel de auto omvormen tot softwareplatform op wielen1, maar gelijk ook het geheel liefst zo volledig mogelijk zelfrijdend willen maken. Zelfrijdend, in de chaotische context die het wegverkeer is. De mogelijkheden en oplossingen kennen drie grote issues, die in een drieluik van hoofdstukken aan bod zullen komen: Wat kan de mens en wat kan de auto, potentieel; waarom pakken we het niet aan met centrale aansturing of coördinatie en; wat kunnen we dan wel – waar staan we nou eigenlijk met aai-oplossingen? Dit stuk, het zal niet verbazen, bestaat net als Gallia2 uit drie stukken.

Soort-van waarschuwing: Dit is een longread…

Deel 1: Goto HumanDriver Considered Dangerous

Hier pakken we dus de eerste vraag op. Met vooral aandacht voor een element uit het ‘system’ dat we of het nu homo ‘sapiens’ is of HAL, in de auto de functie heeft van Central Scrutiniser3: De Bestuurder. Wat kán die, hoe beslist die ..?

De meesten van u zullen het wel hebben meegekregen; het resultaat van een groot onderzoek van MIT4 over beslissingen die een Moral Machine zou moeten nemen om aan te sluiten bij wat wij mensen moreel handelen vinden. Nou ja, het ging eigenlijk alleen over een klein, bekend onderdeeltje van moreel redeneren, het trolley problem. Waarin de keuze moet worden gemaakt om een of meerdere mensen om te brengen, om een of (nog-)meerdere anderen te redden. Een besluit is verplicht, nietsdoen is een keuze voor een van beide alternatieven. [Al is onduidelijk wat de default instelling is in dit experiment…]

Uit het onderzoek kwam van alles naar voren – dat er over de wereld gezien culturele verschillen zijn in de statistisch ‘ideale’ keuzes. Dat het nogal uitmaakt wat er precies aan binaire alternatieven voorhanden is. Dat het uitmaakt wie je het vraagt; ja man/vrouw, jong/oud dat geeft allerlei verschillende maar moeilijk voorspelbare antwoorden. Dat was nog enigszins voorspelbaar. En dat de resultaten desondanks een zware bias hebben doordat de deelnemerspopulatie stevig leunde naar man, hoger opgeleid, welvarend en dus waarschijnlijk meer kosmopolitisch (en dus mogelijk minder religieus), en sowieso deelnemend. Dat soort beperkingen aan de representativiteit worden wel vermeld maar de impact op de resultaten niet (voldoende). Waarmee we dus niet weten of de resultaten bij voldoende biascorrectie wellicht grijs middelmatig vlees noch vis zouden zijn5. Zoals bij de debatten onder ethici over dit soort zaken: Er wordt fraai gedebatteerd en wat was het een interessante uitwisseling van argumenten en filosofische uitgangspunten – maar een eenduidige, snel beslisbare oplossing komt daar nooit uit. Als het probleem in de praktijk zo Onbeslisbaar6 lijkt, dan kunnen we misschien beter ophouden.

Morele Auto’s

Dat het onderzoek beperkt was (is) tot het trolley problem, maakt de resultaten nou ook niet bepaald geschikt voor praktijkgebruik bij bijvoorbeeld zelfrijdende Auto’s7. Die Auto’s zullen heus in veel situaties terechtkomen waar wel meer dan twee alternatieve wegen voorwaarts zijn. Dat er wordt geleerd van de praktijk, is niet noodzakelijkerwijs een oplossing, of beter. Neem het geval van de overstekende voetganger met fiets aan de hand – de Auto herkende dit te laat (als obstakel) om nog rustig te kunnen remmen. De Auto had geleerd om vooral niet te gemakkelijk tot remmen te beslissen omdat bumperklevers al zo vaak schade gaven aan de achterbumper; dan maar liever gewaagd om door te rijden tot het echt niet anders kan oftewel het te laat is voor een noodstop. Exit voetganger. Tsja, economische argumenten gaan nu eenmaal voor.

Dat was eigenlijk al duidelijk toen bleek dat Auto’s veel defensiever reden dan mensen; er was kennelijk nogal wat te processen aan informatie en better be safe than sorry – voor de Auto’s en de verzekeringsmaatschappij … Hetgeen overigens de ruimte schiep (schept?) voor fervente Automobilisten om dan nog veel meer plezier te beleven aan hun hobby, maar dat terzijde8. Post scriptum: De Auto’s zullen dus langzaam rijden, ook al om een andere reden9 – zie ook 75.

System I / II

En er was nog een aspect, dat verder niet aan bod kwam: Het onderzoek vroeg naar de reacties van het (Kahneman’se10) System II. U weet wel, het cognitieve, denkende maar vooral ook langzame deel van uw hersenactiviteit waar morele en ethische overwegingen worden geprocesst. Dit blijkt alleen al uit de koppeling met taalverwerking in de (talige label- en logica)beschrijving aan de inputzijde en in de (weergave en selectie) van de keuze aan de outputzijde. En alle tijd werd gegeven voor bewuste oftewel System II overwegingen. Vooral het laatste is hinderlijk als het aankomt op praktische toepasbaarheid waar snelheid van reactie van zo groot belang is.

Want net als in de menselijke praktijk zullen in Auto’s alleen System I systemen voldoende snel zijn om tijdig ‘morele’ beslissingen te kunnen nemen én dan hopelijk juist te kunnen ingrijpen. Willen de resultaten van Machine Learning (of wellicht in een veel verdere toekomst (sic) zelfs van AI-systemen …) enig nut hebben, dan zullen ze daartoe moeten worden gereduceerd.

En wat moet er dan aan rules voor morele beslissingen worden ingebouwd? Nou ja, wat in het MIT-onderzoek aan mensen werd gevraagd. Of … zou het niet beter zijn als het onderzoek had getest hoe mensen reageren? Maar hoe dan!? want ook als er een prachtige VR-omgeving zou worden gebruikt, zou een ongeloof, hoe licht ook, de werkelijkheidswaarde van de proefopstelling reduceren. Of we krijgen juist ongemak en slechte resultaten door een uncanny valley.

En uiteindelijk is ‘ik raakte in paniek’ een prima excuus. Voor een mens, omdat het O/S in de bovenkamer op tilt ging, al of niet door ongerijmdheden – geldt dat dan niet ook voor een Auto met bugs en software failures …? Hoe zit dat juridisch?

Pseudo-simpel

SystemIPanic() → EffectSomeReflex() dus.

Ja, mensen paniekeren ook, en reageren intuïtief. Maar werden Auto’s nou niet net getraind om System II-beslissingen te nemen voor System II- én System I-situaties? Zo niet, dan moet het hele idee dat Auto’s veiliger zijn dan mensen achter het stuur, worden verlaten. En ziedaar, nog een hele tijd zal praktisch en juridisch verplicht gelden:

IF SystemIPanic() Then

HandBackControlToCluelessHuman();

Else

NothingInsurmountable();

Mijn cursief. Want vergeet niet: Als Auto’s in steeds meer standaardsituaties zelfstandig kunnen opereren – en niemand wil niet uiteindelijk naar Level 5 onafhankelijkheid11, dan zullen betreffende chauffeurs-voor-noodgevallen steeds meer alleen nog worden ingeroepen voor steeds extremere System I panieksituaties. Case studies naar Tesla freak situations12 [onthoud die uitdrukking] zijn veelnegatiefsbelovend…

Die dus ook tot volledig Level 5, het stuur en andere controls bij de hand moeten hebben, contra de wens van iedere ontwerper waarschijnlijk13. Maar ook: Steeds meer zal pas op het écht allerlaatste moment naar de mens worden overgeschakeld.

Wat er dan gebeurt, is dat de mens juist des te minder in staat is dan nog wat uit te richten. Niet alleen zal het menselijk System I toch trager zijn dan het Auto System I en dus juist als het alsnog nodig is, te traag of in ieder geval te laat blijken. 0,3 seconden voor een reflex, was het niet? Of 1 à 2 seconden? Helaas, dat is allemaal al te lang als de Auto ook wat van die tijd verbruikt om te beslissen de boel aan de mens te laten.

Train like you fight

Belangrijker nog, de mens zal het eigen System I niet hebben getraind op werkelijke System I respons. Want die komt uit ervaring en als de Auto in de toekomst tot dan toe alle rij-werk deed en zo vele niet zo extreme noodsituaties oploste, voordat de tot mobiel Netflixen teruggetreden mens14 een reflex zou hebben kunnen ontwikkelen op basis van What-If. Als dat al zou kunnen; What-If is typisch een System II-idee, echte System I-reflexen zijn zoveel moeilijker aan te leren.

Waar dat laatste overigens een beetje goed gaat, is in de luchtvaart: Piloten, en ook vliegers15, moeten liefst in een simulator nog heel veel uren oefenen juist op noodsituaties, opdat eventueel ingrijpen in noodsituaties dan hopelijk op routine kan worden afgehandeld. Train like you fight, then you’ll fight like you trained. Dat werkt, enigszins; er valt niet op te vertrouwen helaas maar we lezen ook regelmatig dat het goed gaat met zulke getrainde reflexen. Waar overigens alsdan nog heel, heel veel System II-denken bij komt kijken; er blijkt dat daar in bijvoorbeeld uit de lucht vallende (even niet meer vlieg)tuigen nog wel een paar seconden of zelfs minuten beschikbaar voor System II-reacties gelukkig. Zo niet, dan is het prompt te laat.

Maar als het gaat om wegverkeer … gaan alle bestuurders, die in zo’n Auto willen rijden omdat ze dan zelf niet meer hoeven rijden ergo geen rijlessen meer willen hoeven nemen en zeker geen échte ervaring willen opdoen, in de nabije toekomst dan massaal juist wél slipcursussen16 etc.etc. nemen, vaak herhaald, om current te blijven waar ze geen praktijk meer in doen? [Inderdaad, dat doen we ook niet met rijbewijzen – maar a. zou dat niet veel levens en schade schelen en b. in het onderhavige geval (auteur is dankbaar deze term weer eens te hebben mogen toepassen) is het belangrijker, omdat waarschijnlijk veel minder recent ervaring is vernieuwd.]

Als dat al alles was… Hoe gaan we zo meteen om met verzekeringskwesties; kan men de mens in extremis17 nog de schuld geven de control niet tijdig en juist te hebben aangenomen als bij voorbaat bekend is dat die mens onvoldoende getraind en ervaren is om die taak uit te voeren en ‘we’ die mens alsnog de weg op lieten gaan? Kan de mens de schuld krijgen als de Auto bij voorbaat te laat de control overgaf? Waar ligt de scheidslijn tussen ‘de mens handelde dus is aansprakelijk, op basis van een kennelijke ethische beslissing waardoor morele aansprakelijkheid volgt’ versus ‘Ik raakte in paniek’..?

Rijvaardigheidsbewijs

Wat nu …? Kinderen inzetten18 ..? Of liever even serieuze literatuur19 bestuderen? Eén voordeel: ‘clueless humans’ kunnen dan ook tegen zichzelf worden beschermd. Rijbewijs inleveren gaat dan heel simpel20. Of kiezen we voor een puntenrijbewijs waarop we naar mate onze ervaring met zélf rijden in crisissituaties stijgt (of uit decennia verleden van zelf rijden is opgebouwd), méér punten krijgen en juist daarmee de Auto méér mogen laten doen? Dat valt vrij gemakkelijk met NFC te regelen, toch? Dan regelen we ook gelijk dat een Auto kan weigeren met déze chauffeur achter het stuur (?) de weg op te gaan, omdat er meer chaos op de weg (route uiteraard vastgelegd) wordt verwacht dan volgens de punten van, door deze chauffeur kan worden gehandlet.

Alleen: Hoe tonen wij, om aan bekwaamheidspunten te komen, aan al échte panieksituaties te hebben doorstaan (met beperkte blikschade…)? Hoeveel punten kost anderzijds rijden onder invloed, of leveren veel ervaringspunten ‘vrijstelling’ op voor een promilletje meer? Is er een verschil of de ‘backup’chauffeur dan wel het doel van het transport is, van A naar B wil, dan wel dat het puur om de vracht (klanten, echgeno(o)t(e), kinderen, lading) gaat? Waarom zouden we anders non-human berijders willen, als die als hierboven weergegeven, niet echt helpen qua veiligheid.

Jong niet geleerd

Waarop ‘jongeren’ van zeg ná de doorbraak van de draadlooze telephoon ongetwijfeld zullen claimen dat ze door al het gamen (GTA springt in gedachte) de facto in een simulator hebben geoefend. Jammer maar helaas; ook vliegers geven aan dat ze door simulatoroefening weliswaar tot 80% minder vlieguren zouden hoeven maken in hun F35 (over een geïntegreerd system gesproken), maar ze zijn nogal zeker dat voor die 20%+ die over blijft, simulators nooit goed genoeg zullen zijn. De praktijk is toch een stuk je ne sais quo anders. Dus piloten in de simulator: Ja, alle, graag, en veel en vaak. Net als senior accountancypartners overigens in een heel andere tak van ‘sport’ ongeacht alle AI-koppeling van process mining en 100% datagerichte ML-controle toch nog heel veel handmatig zullen (moeten) laten vinken: Ja dat moet21. Kunnen we voor alle rijbewijshouders ook zo’n soort ‘handmatig steekproeftoezicht’ regelen, zonder al te veel bureaucratische missers?

Misschien moeten we al die jongeren zonder ervaring dan maar wel de weg op laten gaan en ze op random momenten als er nog geen sprake is van echte paniek, plots zelf in control brengen en zien hoe ze het er vanaf brengen22. Hoewel: Wat als het dan misgaat ..?

Conclueless

Dan is de conclusie:

We moeten bij voorbaat bovenstaande

If SystemIPanic() Then

HandBackControlToCluelessHuman();

Else

NothingInsurmountable();

vervangen door

If SystemIPanic() Then

GiveUpAlreadyAsTheHumanWillAlsoBeClueless();

Else

NothingInsurmountable();

En dat willen we nou net niet…

We willen toch een Auto die ons vrijlaat om met 130km/u onze (?) TikTok / Happn / Bumble te checken?

Het moge duidelijk zijn: Het system als geheel moet even resilient zijn als nu. Dus waar nu de mens als centrale component heel veel opvangt, zal zo meteen ‘iets’ dat moeten zijn. Helaas, wie daarbij beweert dat mensen daar goed in zijn maar machines niet, of dat machines (Auto’s) het uiteindelijk wel zullen kunnen … verwijzen we naar James Gleick’s Chaos23: Juist zeer eenvoudige en uiterst rationele systemen met feedback loops kunnen (alleen al in een gesloten omgeving, waar bij wegverkeer geen enkele sprake van is) zeer chaotisch, onvoorspelbaar gedrag vertonen. Dat kennen we wel van de echelons boven ons in de organisatie, maar willen we liever niet in tegemoetkomend verkeer …

Ja dit alles dus nog afgezien van de hackability van de Auto. We hebben voor het gemak het onderwerp van adversarial attacks nog maar even niet genoemd. Die zijn asymmetrisch; één hacker (en dat hoeft in dit geval niet eens zo’n slimme te zijn) hoeft maar één serieus adversarial example te bedenken en het verkeer is danig geraakt: De exploit scalet direct naar alle zelfde-softwaretype24 Auto’s. En als een Auto wordt gehackt, hoe die dan manual over te nemen als een overname door de hacker kan worden geblockt? À la ransomware wordt u vanzelf naar een duister afgelegen industrieterrein gereden. Over scalen zal het in het volgende stuk gaan. Als top-down oplossing, en als probleem.

Waarom wilden we ook alweer zelfrijdende Auto’s ..?

Deel II: Aangestuurd Autorijden

Hierboven zagen we dat een Auto, een zelf-, Automatisch rijdend vervoermiddel, ons op een afgelegen parkeerplaats nog wel van A naar B kan brengen, maar anders dan de graceful degradende mens in het hedendaagse verkeer brittle is. Ja, een Auto kan misschien (eens) beter rijden dan een mens en misschien ooit meer complexiteit aan, maar als het ophoudt, is het gelijk Einde Oefening. De vraag dringt zich dan op: Kan er niet ‘iets’ centraals worden gedaan, zodat al het verkeer vanaf een groot regelsysteem wordt gestuurd ..? Zoals Een bedrijfje dat ook hyperloops bouwt, al jaren blijkt te doen…25

Vorige keer kwam zhij al voorbij: de Central Scrutinizer. Want als dat niet de bestuurder is, kan zij dan aan het andere eind van het spectrum worden gevonden, in de vorm een verkeerscentrale die alle wegverkeer bewaakt en bestuurt ..? Te denken is aan zoiets als een Verkeerscentrale Nederland – die al bestaat, het VCNL is gevestigd in Utrecht Papendorp en … bewaakt het verkeer in ons land. Nou ja, de A- en een deel van de N-wegen26. En alleen de bewaking en centrale regievoering over de paar decentrale centrales rond de grote steden. Wie doet het verzamelen van file-informatie, het adviseren van alternatieve routes, het stratificeren en vertragen van de gemiddelde snelheid met matrixborden (en het afkruisen van rijstroken)? Juist27. Vooralsnog is er gelukkig geen enkele vorm van actieve aan- of be-sturing van het verkeer laat staan individuele weggebruikers…

Maar hoe eenvoudig zou het dan zijn om bijvoorbeeld per stad, als nog enigszins behapbare eenheid en als invulling van een deel van het28 Smart City-concept, alle verkeer op camera te vatten en te reguleren? Zeker Auto’s kunnen hun bestemming wel on the fly doorgeven, zodat de centrale botsingen kan voorkomen van Auto’s met niet-aanstuurbare verkeersdeelnemers. Van die ongure elementen als fietsers29 en voetgangers met hun zo afwezige stuursoftware in de bovenpan. Gaat maar eens in Amsterdam kijken hoeveel fietsers zich aan de regels houden en verbaast u (niet) dat de meter op de nul zit vastgepind. Een prima idee om Auto’s dan centraal aan te sturen zodat individuele bestuurders niet uit nijd fietsers gaan snijden…? Met als additioneel voordeel een situational awareness die de routes van Auto’s kan aanpassen als het ergens te druk dreigt te worden.

En met als grootste voordeel dat economies of scale te bereiken zijn in de rauwe rekencapaciteit die nodig is. Centralisatie uiteraard in architectuur, niet noodzakelijkerwijs in geografie. Lekker load balancen over de Nederlandse gemeenten levert best wel wat resilience op tegen pech30.

Mega Minnetjes

Enkele nadelen zijn er ook…

Zo zal het lastig zijn om over gemeentegrenzen heen te coördineren. Wellicht bieden koepels als Veiligheidsregio’s uitkomst. Lastiger wordt het om binnen gemeenten de juiste expertise te verzamelen. Er nog van afgezien dat de ervaringen bij decentralisatie van bijvoorbeeld de jeugdzorg nou niet zo hoopgevend zijn. Nu is er hoogstens wat manual verkeersregeling bij lokale evenementen en verder ligt het bij het VCNL. En, zeker als we ‘dwingend’ willen gaan sturen, hoe regelen we dan de mandaten? Wie denkt dat ‘de overheid’31 het wel voor elkaar zal (zou kunnen) krijgen, vergeet dat ons bestel niet geschikt is voor de toekomst32.

Waarmee we een gevoelig punt raken. Want centrale aansturing en identificatie van Auto’s en hun beoogde route; da’s toch wel het ergere soort inbreuk op de Avg denkbaar. Jaja, natuurlijk zijn de Auto (die zich moet ‘identificeren’ bij route-doorgave) en de bestuurder niet dezelfde, maar depseudonimisering is in dit geval triviaal. Er zijn met beacons in elke Auto geen nummerborden meer nodig maar er is dan wel een totalitaire database – die, zo leert de praktijk, gehackt zal worden.

En overal camera’s, op elke blinde vlek in de openbare ruimte (want een overstekend mens kan uit ieder onverdacht hoekje komen); meer Big Brother is nauwelijks te krijgen. Vergeet niet dat ook voetgangers en fietsers triviaal te deanonimiseren zijn. Er hangen al veel te veel camera’s in gemeenten waar de beveiliging laat staan de rechtvaardiging33 zoek is. We staan minder ver van maximaal repressieve regimes dan we denken. Waardoor de druk voor maximale bewegingsvrijheid in de niet voor niets openbare ruimte, zal toenemen. Systemen zullen inherente repudiation moeten hebben; absolute, bewijsbaar onmogelijk deanononimiseerbaar moeten zijn. Als dat theoretisch niet lukt, dan maar gewoon helemaal niet ..?34

Onveiligheidsgordels

En de Gemeentelijke VerkeersCentrale is natuurlijk een onoverzichtelijk architectuurcomplex35. Wie beweert dat de beveiliging ervan heus wel goed geregeld zal zijn, heeft de afgelopen vijftig jaar van overheidsautomatisering gemist. Qua continue beschikbaarheid (ransomware, of triviale on-beschikbaarheid door systeemfalen36) ontstaan eenvoudig problemen door de vele externe connecties; Auto’s die vertrouwen op centrale aansturing of coördinatie zullen zonder dat al snel de weg kwijt zijn.

Qua vertrouwelijkheid zal het ook niet zo Top zijn. We hebben het over gevoelige gegevens en grote datasets. De vraag is niet of, maar wanneer. Natuurlijk zal niet direct een premier worden ontvoerd als des betreffende rijroute uitlekt, en de maatschappelijke schade (zijnde?) daarvan is ook geen zorg voor velen. Lastiger wordt het, als criminele groepen door route-analyses elkaars opslagruimtes weten te lokaliseren, of bij uitrukkende Hermandad de route inclusief eindbestemming uit het systeem weten te plukken. En denk ook aan de natuurwet van scope creep; als de (route)data er is, zal dat een onweerstaanbare aantrekkingskracht hebben op totalitair-bureaucratische lieden (vroom in voorkomen, moreel verschimmeld) die in welke overheid dan ook, onuitroeibaar blijken37.

En de integriteit van de data … dat wordt dynamisch-GIS-werk38. Want we hebben naast een enorme verzameling statische informatie over wegen, stoepen, losliggende tegels (denk aan daardoor plots uitwijkende scootmobielen en slingerende fietsers), etc.etc., ook nog een veel grotere verzameling bewegende datapunten (Auto’s, en eventueel ‘bussen’ en van die klassieke auto’s van bouwjaren tot 2022 ..!). Wat als er iets misgaat in de communicatie? Ruis en vervuiling zullen al snel onwerkbaar overheersen in de database. Verdraaiing (manipulatie) kan ook bewust gebeuren; zie hieronder, en reeds bestaand als service voor VIPs die niet willen worden gevolgd. Wordt al misbruikt, ook. Om over de integriteit (juistheid etc.) van de ‘uitkomsten’ van het systeem maar te zwijgen; wat betekent ‘ik raakte in paniek’ van het centrale systeem?

De vraag is of het hiermee ooit goedkomt… En als er door niet-integere data iets fout gaat, of door een lek, gaat de gemeente de materiële én immateriële schade dan betalen, zonder dat de belastingbetaler daar dan weer voor opdraait?39

Summa summarum; Ook hier zijn ervaringen uit het verleden geen hoop voor de toekomst.

Als laatste nog een nadeel: Door al die ongeleide projectielen als voetgangers en fietsers, en niet te vergeten de vorige keer al genoemde non-Auto’s40, zullen Auto’s zelfs bij centrale aansturing defensief gaan rijden, aan de achterste mem hangen qua praktische voorrangverlening op andere, niet-Auto’s. Dat zal zeker ook gaan spelen bij treintje-rijdende Auto’s; die zijn minder flex dan enkelvoudige Auto’s én nemen veel (omgevings)beslisruimte in – en zullen dus nog voorzichtiger gaan optreden tegen al die bedreigende losse, relatief kleine, projectielen die in de beslisruimte binnen komen zeilen.

Dan maar met z’n allen in de modder

En het voornaamste bezwaar zit ‘m natuurlijk in het onderbuikgevoel dat we onze vrijheid niet kwijt willen, en zeker niet in een achterhaalde utopie van maakbaarheid van de samenleving willen verzanden. De geschiedenis van de mensheid heeft toch wel aangetoond dat we daar niets van hoeven te verwachten. Maar wat als we nou eens zouden overschakelen naar het andere uiterste; een anarcho-syndicalistische commune41 ..?

Een fijnmazig net van overigens zelfstandige maar onderling samenwerkende Auto’s dus. Die allerlei informatie over het wegverkeer (van het inherente gevaar van de moderne fietser laat staan de elektrische, tot en met kleine kinderen en ballen42 op de weg) niet alleen zelf opdoen, maar ook doorgeven aan Auto’s in de buurt. Zodat eenieder een deel van de omgevingsawareness bijdraagt, en van het geheel kan profiteren.

Misschien dat een gemeente dan toch wel iets kan bijdragen. Wilt u het totale meetlussysteem!? dat ook fietsers en wandelaars registreert? Ja, want wij willen Netflixen achter het stuur! Niet zo chill43, 44. En de centrale is natuurlijk even betrouwbaar als boven. Of minder, want het belang van integriteit lijkt lager. Voor de gemeente! En wat kost het onderhoud van zo’n zéér fijnmazig meetlusnet wel niet? Dus dit is toch niet zo’n briljant idee.

Een mesh zonder centrale database kan uiteraard ook. Het hoeft niet direct een speculatie-speeltje als een blockchain te zijn. Die is in de benodigde communicatie en computatie te zwaar voor de individuele betrokken Auto’s die toch al moeite hadden met het denkwerk voor zelf rijden. Laten we het simpel houden (maar niet simpeler). Wel zal er flink gecommuniceerd moeten worden tussen Auto’s. Wat nog wat problemen zal geven, want hoe kunnen we die andere Auto’s vertrouwen45? In Deel III komen de adversarial attacks voorbij; nu al: Als onze Auto een gemanipuleerd beeld oppikt en doorgeeft aan een andere, zijn we dan mede-aansprakelijk voor de gevolgen? Mensen zullen de teruggekeken beelden toch als ongemanipuleerd zien, toch, dat was nou net de “grap” (quod non)?

Verstoord, stuurs; niet sturend

Ook andere verstoring van al die communicatie is denkbaar. En wat als er weinig Auto’s op de weg zijn, maar wel andere weggebruikers? Dan is er weinig Auto-to-Auto te babbelen, maar kan het toch druk zijn. Dan heeft de Auto relatief veel zelf te zien en berekenen, maar nou net dan relatief veel te weinig informatie46 en zal dus des te langzamer gaan rijden. Met niet in druk weer te geven reacties van voorbijflitsende fietsers.

Daarnaast kan ik nog wel wat bedenken: Mijn Auto geeft data door die andere Auto’s collectief aan de kant zet47. Want ik wil lekker veel ruimte! Dit werkt zelfs als ik op mijn fiets48 een transponder zou monteren die een vijftigtonner truck met aanhanger simuleert49. Of een bus of wat dan ook – als we data gaan zenden, staat het stoplicht voor mij altijd op groen het is hier Almelo niet.

Sommigen zouden dan weer willen eisen dat álle fietsers en wandelaars (en de kat van de buren; wanneer houden ze dat beest nou ‘es binnen) met een transponder de deur uitgaan. Anders is de ‘dekking’ te laag ..? Maar, afgezien van een enkeling50 (moi?) die denkt boven de regels te staan en zelf geen last te hoeven hebben van wetten voor de hoi polloi, wie wil dat nou?

Tussenconclusie: 1. Centrale control gaat niet lukken; 2. Een mesh van samenwerkende Auto’s kán, maar 2a. is ook (te) kwetsbaar en 2b. voorziet niet in fietsers, wandelaars, non-Auto’s, juist waar het om ging qua operationele risico’s.

Zo zien we; organisatie van het verkeer volgens Stalin of Bakoenin, beide zijn niet geheel geschikte modellen voor een artificieel-intellectuele voorhoede van bourgeois-Auto’s.

Grote strategieën, kleine burgerkarretjes

Qua grand strategy objective ziet de meshed Auto er dus wel goed uit, maar gewone strategie is niet die stip aan de horizon maar juist de weg ernaartoe en op dat vlak kunnen we maar moeilijk vooruit51. Want we zullen hoe dan ook naar een of meer tussenfasen moeten waarin niet iedereen een transponder bij zich draagt. Dieren, kleine kinderen: die moeten dan maar met een chip worden geïmplanteerd? Het is voor hun eigen veiligheid! Bovendien is het aantal Auto’s-huidige-generatie nog uiterst beperkt en zal nog zéér fors moeten groeien om serieus baat te krijgen van eventuele mesh-communicatie. De overige weggebruikers zullen moeten uitfaseren – dat kost generaties.

Als de maatschappij al die kant op wil. Noch ‘het zal wel moeten’ noch ‘maar dat willen de mensen toch’ zijn steekhoudend en beide volstrekt belachelijk, zeker in de tijd. Wat we op middellange termijn kunnen voorzien, is misschien niet eens een verdere verAutorisering maar juist een slinger weg van Auto’s, naar fiets, bus52, trein en wellicht eerder vliegende Auto’s (ja eindelijk!). Enne, Smart Cities: Was niet de bedoeling auto’s én Auto’s daaruit te weren zodat we de laatste 10km naar onze bestemming kunnen wandelen of fietsen, come rain or shine ..? De bus duurt te lang en dan zit je nog met al die onwelriekende anderen, en dan kom je nog niet voor de deur waar je wilt zijn. En taxi’s: dat zijn Auto-auto’s (sic; tekenend dat het belachelijk-om-disruptief-te-noemen Uber álles heeft geautomatiseerd behalve de chauffeur ..!).

Dus eerst maar eens naar zo’n tussenfase; onduidelijk is welke (mixed-mode rechtuit of ontauto’en) en in onderling enige disjunctie.

En ja dit alles dus nog afgezien van de hackability van de Auto en adversarial attacks. Dat was eigenlijk onderwerp voor dit 2e deel bedoeld. Maar logica gaat boven plan, daarom zal de Auto zelf in het derde deel alsnog aan bod komen. Misschien zal dan wel blijken dat we, zeker op korte en middellange termijn, niet kunnen wat we willen met artificial intelligence; dan moeten we met Auto’s maar willen wat we kunnen. Ook als dat niet zo veel zal blijken te zijn. Dan krijgen we de A sowieso wel voor elkaar, en gaan we naar een beter begrip van de benodigde I toe. Dat overstijgt het nauwe (?) veld van AI-voor-Auto’s maar kan via een shift van denkwijze wel een betere toekomst brengen.

AI, Max!

In deel I zagen we dat zelfrijdende Auto’s zelfs in combinatie met menselijke back-up chauffeurs nog (veel) te weinig zelf kunnen om veilig zelfstandig de weg op te mogen. Waarbij voor het gemak nog voorbij was gegaan aan de kwetsbaarheden die aan al die software kleven. Er schijnt in Gelderland een stuk weg te zijn waar al diverse T…’s [betreffende Autofabrikant zal wel anoniem willen blijven] naast de weg in de sloot zijn beland. Een soort anti-lane departure correctie. Is dat nou een feature of een bug53? Zo zullen er ongetwijfeld nog vele kleine ‘dingetjes’ net niet helemaal netjes zijn uitgewerkt, en het is nou niet alsof iedereen doelgerichte proefritten gaat maken om nieuwe functionaliteiten te testen voor een patch op het motormanagement door te (laten) voeren. Dat doen uw IT-beheerders voor nieuwe software-patches wel, waarom zouden de ‘eindgebruikers’ dat voor Auto’s niet hoeven doen? Aansprakelijkheid is een heikel ding, in de Autowereld.

Krak. Wrak.

Andere kwetsbaarheden die nog zomaar ongenoemd waren, liggen op het vlak van beheer en beveiliging in engere zin (afscherming). Wie denkt dat het met het Identity- en Access Management wel goed zit, heeft hopelijk een goede levensverzekering voor de nabestaanden. Zie bijvoorbeeld het prijswinnende Hacker gehackt van Joost Geerts in iB Magazine 2020-5: een inbraak ligt in een klein hoekje. En het gaat niet alleen om de spraakmakende inbraken waarbij een complete Autobesturing wordt overgenomen (qua haalbaarheid al aangetoond) – wat in zulke gevallen zowat gelijk een class break is; alle Auto’s met dezelfde software kunnen door hetzelfde gaatje worden gehackt. Het gaat óók over de hele software-ontwikkelketen. Waar ransomware al steeds vaker via supply chain attacks binnenkomt, zal dat voor Autosoftware-kraken zeker ook een optie zijn, en blijven.

Waar we in de informatiebeveiligingswereld onszelf bezighielden met statische servers54 en de in de loop der tijd geëvolueerde software-ontwikkelmethodieken en informatiebeveiligingsformules (denk aan ‘standaard’ Identity- en Access Management, OTAP-straten/waterval of ‘Agile’-quod-non55, Change Management-procedures, et al.), zien we dus een forse toename aan reikwijdte van ons werk. Waarvoor we nog bezig zijn de standaarden te ontwikkelen. Evolutie van de huidige standaarden kan wellicht al te weinig zijn om de exponentiële complexiteitsgroei van de problematiek aan te kunnen – we rennen immers snel vooruit zonder goed fundament; we moeten steeds harder rennen om op dezelfde plaats te blijven / deden we ten minste dát maar!

En uiteraard is OT-security56 voor velen een nog veel te onontgonnen terrein: voor vakgenoten én voor onze klanten; in het land der blinden lijkt eenoog al snel koning. Dus wie een halve-carrièreswitch overweegt: Kijk eens naar dat OT-security…!

Oh Oh Overheid

In het vorige deel bleek ook dat ‘centrale’ aansturing of hulp ook al niet gaat helpen, of van de wal in de sloot qua privacy en eigen verantwoordelijkheid. Misschien kunnen we nog wel wat met dynamische wegmarkering – maar dat riekt natuurlijk direct weer ‘sturing door een overheid’ en de ervaring leert dat zulks niet vanzelf altijd maar goed gaat. Smart parkeerplaatsen, verkeerslichten: idem – en stel je voor dat een fabrikant het voor elkaar krijgt om de eigen Auto’s bij de verkeerslichten voorrang te laten geven57.

Al hetgeen met centrale besturing samenhangt, komt al snel uit bij de Grote Drie van bezwaren tegen overheidsbemoeienis: 1. Ik wil niet dat de overheid weet waar ik ben, 2. Ik wil niet dat de overheid stuurt op basis van potentieel (sic) willekeurige discriminatie of wat dan ook tegen art.1 vd Grondwet, 3. Integriteit van data is niet in het belang van degene die de integriteit kan beheersen. (De overheid heeft geen belang bij de integriteit of gebrek eraan (zou hooguit zo reageren) die mij specifiek zou kunnen hinderen, ik wel; voor toezichts- of controlemogelijkheden is het andersom: een typisch geval van verkeerd belegde incentives en afschuifbare externaliteiten.

Vooralsnog blijken ook degenen die middenin de ontwikkelingen rond zelfrijdendheid58 bezig zijn, beseffen dat de wereld iets ingewikkelder is dan gedacht. Het als grote jongen roepen van uitdagende doelstellingen is altijd een risico, en zeker als het om realiseringsdatums voor zelfrijdende Auto’s gaat. Ene Elon M. van garage T. is al op zijn beloften terug moeten komen59,60. Ook anderen zijn voorzichtiger geworden, of zijn zelfs opgehouden met vooraan willen lopen.

Niet linksom, niet rechtsom, dan maar …?

Als tussenconclusie moet dan ook gelden dat de ‘AI’ van zelfrijdende Auto’s niet verder is dan bijvoorbeeld dat andere ‘poster child’ Watson in het medische domein, namelijk: echt nog niet beter dan mensen61. Ook de winst van Watson (niet één maar 42 samenwerkende machine learning systemen!) bij Jeopardy was niet zo indrukwekkend als men wel denkt. De vragen waren in een nog steeds relatief gesloten en beperkt domein, Watson won maar net, en had een aantal domme foute antwoorden en onbegrijpelijke missers. En het basisopzoek- en rekenwerk was niet zo ‘intelligent’62.

Het enige werkveld waar redelijk ongestoord voortgang wordt gemaakt, is er een waar we dat misschien niet echt zouden moeten willen; Autonoom schietende killer bots. Nu nog heel experimenteel (maar wél volledig autonoom functionerend, zo inzetbaar!) in het militaire domein, met de nodige blunders, ethische vragen63 en praktische problemen. Zometeen misschien al paramilitair of ‘ordehandhavend’ bij onwelgezinde politieke demonstraties? Hoewel auteur nog wel nut ziet in na-montage van zoiets als accessoire64 op de eigen auto.

De Autowereld heeft natuurlijk bovendien ook wel bij uitstek te maken met complexiteit. Binnen de Auto (nou ja, het blijft een beperkte fysieke ruimte en het functioneren van de onderdelen is gesneden koek), maar vooral ook in de omgeving. Zó veel actoren en passieve objecten vind je niet snel in andere domeinen waar het met AI al niet opschiet, dus voor Auto’s wordt het lastig:

Waar vinden we zoveel actoren? Tot nu toe bleek een fietser die achter een stilstaand voorwerp vandaan komt waar die eerst achter uit beeld raakte, twee verschillende objecten met onbekende bewegingsrichting en -snelheid65. Een bal die, om het nog erger te maken onverwachts, de weg op stuitert wordt nogal eens gevolgd door een klein kind; veel kwetsbaarder dan die bal op zich. Dat weet iedereen. Maar uw Auto nog lang niet. Etc. Logisch (sic) maar niet handig. Kennis uit data is nog zo vele factoren minder dan basaal semantisch begrip…

Waar ook is de niet-acterende, passieve omgeving zó complex en onregelmatig? De ene boom ziet er net wat anders uit dan de andere. En verkeersdrempeltjes zijn soms slechts chauffeur-wakkerschuddend, soms forse hobbels. Je ziet het niet altijd aankomen. En er verandert zo veel in de omgeving, zelfs wat stil lijkt te staan. Omleidingen, rijbaanverleggingen, etc. – ja de wereld om ons heen verandert voortdurend66.

Waarnaast natuurlijk het rijgedrag van overige weggebruikers hoogst variabel is. De ene fietser reageert beslist anders dan de andere. Succes, zelfrijdende Auto in Amsterdam…! Maar ook de ene oude-Saab-rijder reageert nog slechter dan de andere67. En wat te doen als wegens verkeersdrukte elders, de Auto een wijk instuurt waar je niet veilig bent ..?

Nieuwsteste AI – klein beginnen, klein blijvend

Wat dus nodig zal zijn – en de eerste ontwikkelingen in lab-opstelling gaan die kant gelukkig ook op – is een exponentiële schaalvergroting in de complexiteit van algoritmiek en berekening. Niet alleen een enorme schaalvergroting en -verdieping van neurale netwerken kan ons redden. Hoeveel lagen méér we nodig hebben en hoeveel breder die moeten zijn (mét variaties in de trigger-functies op de nodes, de backpropagation etc.etc.), met navenant méér trainingsdata; wie het weet mag het zeggen. Heul veul is wel het minste. En dan houden we de issues met de huidige ‘AI’ / machine learning van het alleen maar kunnen interpoleren met de zo snelle afname van relevantie bij extrapolatie, eerste- en tweede-ordefouten die niet noodzakelijkerwijs kleiner worden, over-en underfitting, etc.

Wat erbij nodig zal zijn, is een koppeling met elementen uit de aloude Expert Systemen met hun relatief abstracte symboolmanipulatie op basis van declaratie van axioma’s (‘feiten’) en productieregels. In combinatie met rechttoe-rechtaan gewone procedurele algoritmen68 én anderzijds fuzzy logic. Of is dat laatste een, overgeslagen, extra stap bij machine learning? Gooi er dan nog een forse scheut seeding en tweestaps leren (inprogrammeren van heuristieken uit data of menselijke ervaringen, semi-symbolisch, waarna verder kan worden getraind op data) bij met flexibele neurale-netwerkstructuren en wie weet krijgen we iets zinvols.

Ook pruning, het snoeiwerk in neurale netwerken, is vooralsnog te weinig van de grond gekomen. En als er na snoeien weinig connecties overblijven, misschien kunnen we dan terugredenerend wel tot kennelijke algoritmen komen, bij wijze van emergent properties in de data ..? Pas dan hebben we inductieve wetenschap. Nou ja, inductieve berekeningen; naast de deductieve traditionele algoritmen.

Zo ver zijn we helaas nog lang niet. We zullen ‘AI’ nog wel weer een derde keer69 een ‘AI-winter’ ingaan. Hoewel vorige keren óók een klein aantal toepassingsgebieden best van de grond leken te komen, zal het in het publieke discours beperkt zichtbaar blijven. Afgezien van die paar verschrikkelijk verkeerde toepassingen; discriminerend zodra70 door de overheid ingezet, privégegevens stelen71 als het door private partijen gebeurt. En ach, de paar puntoplossingen die ‘AI’ nu Automatiseert in bedrijfsprocessen… RPA is ten slotte ook maar het oude straight-through processing gekoppeld aan een net wat bredere variatiemogelijkheid in transacties dan het massief on-Agile (sic) Lean Six Sigma-denken72. Al zijn er nog steeds een aantal betrokkenen die geloven dat het met rechttoe-rechtaan hard doorwerken zou moeten kunnen lukken, met Automatisch rijdende Auto’s73.

Met Auto’s naar Zandvoort

Nee, voorlopig zullen we het moeten doen met, als het eventueel toch zou lukken, een Formule A(uto-matically driven by software). De Formule 1 e.v. waren toch altijd officieel bedoeld als testomgevingen voor het neusje van de zalm qua techniek? De data hebben ze al74 en daar past het zelfrijdende, dat als neusje van de zalm qua Autotechniek geldt (of ooit zal gelden), toch mooi bij ..? De belofte was dat nou juist het stukje Sturen te Automatiseren – dat was zowat als enige deelprobleem niet met techniek oplosbaar maar nu wellicht wel. In plaats van wat waaghalzen-met-andermans-kapitaal kunnen we nu terug naar het testen van de beste nieuwe technieken ..! Maar dan is het geen showbizz meer maar (software-)vendors die tegen elkaar pitchen.

Ga maar na: De situational awareness (andere Auto’s, gele vlaggen wegens olielekken etc.), is voor alle teams gelijk te trekken met centraal verwerkte en doorgegeven beelden want het privacy-idee van artikel II is hier niet relevant. En wie wat extra’s wil qua omgevings-awareness kan dat gemakkelijk toevoegen. Bandeslijtage, specifieke eigen technische parameters: Laat maar zien dat die ‘perfect’ worden verwerkt. De verwerking van al die data kan in de Auto óf gewoon in de pits zoals nu al wordt gedaan, toch?

Het zal wat ver buiten ons beeld zijn – want saai (geen Max- maar Lewis-stijl) en stil want we gaan er wel vanuit dat elektrisch de toekomst heeft. Dus da’s het voor publiek niet aantrekkelijk om te zien, live of vanuit huis. Maar het kan bij uitstek een enigszins beperkt complexe ‘omgeving’ geven om het zelfrijdende van Auto’s steeds verder te ontwikkelen. Ook het bezwaar tegen de huidige -1 klasse [en andere] van veel benzineverbruik om nietsweinig researchrendement, kan dan qua Auto e-variant eens, broodnodig75, goed worden onderzocht én verbeterd. In plaats van maximale tankinhoud op naar maximale kW-oplading en extreem versnelde oplaadtijden ..? Tot ze, eens, alsnog de weg op kunnen. Er is zelfs een minieme kans dat Tesla dan nog bestaat.

Kai Zen: Kleine stapjes

TL;DR of zo

Laten we ondertussen in de gaten houden waar we met puntoplossingen puntproblemen kunnen aanpakken. Dus niet al te complex – het lijkt wel alsof complexiteit van problematiek, inhoudelijk en qua context, de achilleshiel is van AI / machine learning. Misschien moeten we juist veel meer experimenteren met bijvoorbeeld RPA. Al is het een klein issue, met klein nut, we kunnen wel leren wat het kan en vooral wat het niet kan.

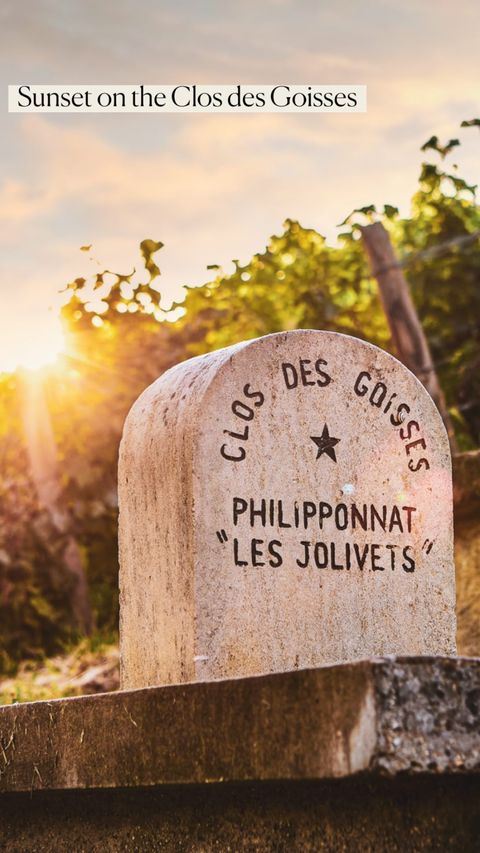

En we kunnen op zoek naar vergelijkbare ‘probleemgebieden’ om AI verder te helpen. Zo is auteur dezes vanuit een brede interesse in alles wat met wijn te maken heeft, heel blij met de ontwikkeling van geautomatiseerd wijngaardbeheer. Airborne drones kunnen individuele stokken met spectraalanalyse controleren op het begin van ziektes, en (dezelfde of terrestial rondrijdende) drones kunnen dan alleen de stokken die het nodig hebben, bespuiten met bestrijdingsmiddelen76. Dat scheelt een hoop bestrijding! We zijn bijna zover: Alleen de geautomatiseerde koppeling van lucht naar grond ontbreekt nog. Nu nog het snoeien en de pluk automatiseren. Moeilijk, want fysiek delicaat en zeer ervaringsgebonden. En het proeven77, dat kunt u aan Auteur overlaten.

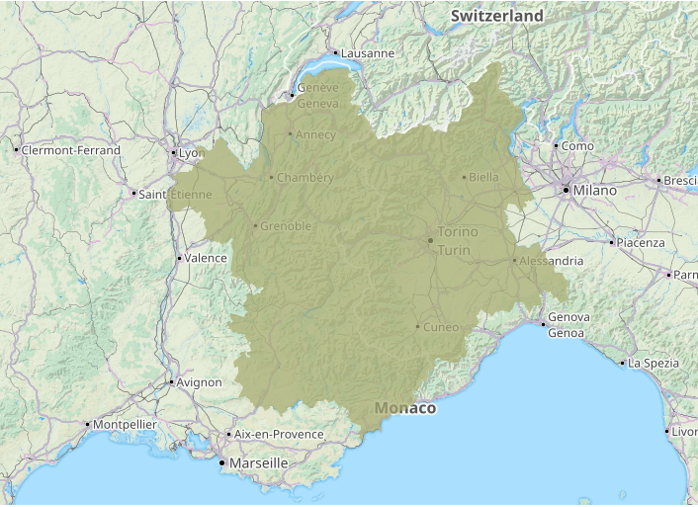

Tijd voor een plaatje!

[Vignobles Savoyardes; vue au Chautagne du Granier]

Oh en laten we ondertussen ook wel de langer-termijnontwikkelingen rond ‘AI’ in de gaten houden! Dan bedoel ik niet de nieuwe Algoritme-Toezichthouder uit het ‘regeerakkoord’ [mag het die naam wel hebben..?] die op z’n vroegst pas over anderhalf jaar start en dan nog wel een decennium nodig heeft om een béétje op gang te komen. Maar zoals bijvoorbeeld hier geschetst, ondanks de derde69 AI-winter gebeurt er echt niet niks…

Eindnoten:

- 1 Waarbij de softwarekwaliteit en de niet-zo-standaard IAM rond software-updates inderdaad enorme problemen geven, maar ook de primaire kwaliteit van al die steeds meer zelfrijdende code. Er is meer aan de hand dan alleen het wat minder hackbaar maken van het Musk’se model T; daarover is elders op het ‘net wel genoeg te vinden…

- 2 Ja, ja, Gallia in omnes parta divisa, niet slechts tres. Maar dat was een verschrijving; we weten heus wel dat Frankrijk eigenlijk bestaat uit Aquitanië inclusief het graafschap Foix, de rest van de Langue d’Oc en Bourgondië (cultureel als één te beschouwen, wie goed kijkt) inclusief de Chablis en Champagne (qua hoogtepunt van cultuur, Wijn, duidelijk bij de rest horende), en de restjes voor de Franken rond Isle de France. We ‘missen’ dan de Brie die we aan die Germanen laten maar ach, dan hebben ze ook wat. Zie overigens het slot van dit stuk – dat ‘ook’ uit drie delen bestaat, dus.

- 3 <deze link>

- 4 <deze link>

- 5 Nota bene, dit soort cultuurgebonden ethiek blijkt bij alle ‘fairness’-discussies zwaar onderbelicht maar wel degelijk aanwezig. Wat ‘wij’ [als u Nederlands leest, behoort u waarschijnlijk tot min of meer hetzelfde cultuurgebied als Auteur] discriminatie vinden, zal in andere culturen totaal niet worden gezien als issue, misschien niet eens worden gemerkt als afwijking van ethisch verantwoord gedrag. Die andere culturen dan willen overtuigen van ons gelijk, is zó twintigste-eeuws cultureel-Westers imperialisme ..!

- 6 <deze link>

- 7 Dat is overigens een tautologie; Auto als afgeleide van auto-mobiel vertaalt toch naar zelf (voort)bewegend of hoe was het ook alweer. Vandaar de notatie vanaf hier: Auto

- 8 <deze link>

- 9 <deze link>

- 10 <deze link>

- 11 <deze link>

- 12 Door Ellen Wesselingh (deze); expert op dit gebied

- 13 Waarom rijden we nog niet met side stick (<deze link>) ..?

- 14 <deze link>

- 15 <deze link>

- 16 Anders dan de slib/ptong, kan dit slechts met een p.

- 17 Onduidelijk is waarom De Telegraaf dit tot lievelingsthesaurusvervanging heeft gemaakt voor ‘in de extra tijd’ bij voetbaluitslagen.

- 18 <deze link>

- 19 <deze link>

- 20 <deze link>

- 21 Omdat zij hun handtekening zetten; hoe meer ze afhankelijk zijn van de machine alleen, hoe minder assistenten er zijn voor de details én hoe minder zij zelf zullen zijn getraind in herkenning van hiding in plain sight fraudeurs et al. – Hetzelfde probleem: Grotere afhankelijkheid, minder ervaring, inzicht en kunde met name voor de uitzonderingen…

- 22 Een idee van collega Maarten Souw. Die heeft wel vaker dat soort verhelderende insights en oplossingen. Overigens dacht hij het beter om auto’s van een simulator modus te voorzien. “Novieten kunnen dan in totale stilstand hun rijtechniek trainen”.

- 23 <deze link>

- 24 Nóg zo’n probleem: Mogen Auto’s zonder alle laatste patches de weg niet meer op? Wat te doen bij een fabrikant die een patch te laat levert? Wat als de patch buggy is?

- 25 Als hier: <deze link>

- 26 Was het, een paar jaar geleden. Wellicht is er al wat uitbreiding, maar willen we fileberichten over drukte op de Jan van Galen als we op de Vestdijk vast staan ..?

- 27 [Disclaimer: Ik heb geen aandelen in het VCNL. Het is een onderdeel van Rijkswaterstaat.]

Maar voor wie een idee wil krijgen wat zo’n centrale zou kunnen betekenen, bijvoorbeeld voor een ‘Smart City’, zou het PvIB eens een rondleiding moeten organiseren daar. - 28 Wie daar een eenduidige definitie of beeld van heeft; gelieve u te melden. Bestáát dat ..?

- 29 Ervaringen uit eerste en tweede hand leren dat het juist niet-ouderen zijn die vooral elektrische veél te hard op weg naar School of 10-minutenserviceafleveradres zich gedragen als ongecoördineerde hoogbejaarden [dat bedoelt auteur dus als typeduiding, niet pejoratief] – zeker door een gebrek aan fietservaring na altijd maar met de auto naar school gebracht te zijn dus onvoldoende besef te hebben van wat ‘beheersing’ inhoudt.

- 30 Maar juist niet tegen Acts of Man. Acts of Nature zijn lokaal, Acts of Man (aanvallen) zullen op het systeem als geheel zijn gericht en dus grootschaliger zijn – en dan gecoördineerd moeten worden opgelost, met zo een grote kans op niet-slagen. Belangrijker; Acts of Man kunnen ook vanaf een overigens vooral toeristisch / vrijetijdslevensstijlvriendelijke locatie worden uitgevoerd, voldoende ontraceerbaar.

- 31 Voor de burger is de opsplitsing in Rijks- en lagere overheden en ZBO’s en agentschappen en de Belastngdienst en de (?) politie en … en …, volstrekt irrelevant. En volstrekt transparant, zoals bij alle (onder)uitbesteding voor de private sector ‘ook’ vereist is; althans dat zou moeten maar is juist waar het Kafkaëske binnentreedt.

- 32 Zie <deze link>, ook op <deze link>

- 33 Knullige smoesjes daargelaten.

- 34 De maatschappelijke tweespalt tussen bureaucratie die vindt dat alles moet kunnen als er maar het kleinste winstpuntje uit te halen valt, en de maatschappij die steeds meer Algemeen Belang in termen van vrijheid, gelijkheid en broederschap ziet, zullen we hier maar niet al te ver doorakkeren; een mer à boire, voor een IB Magazine-special misschien…? Meenemende Hobsbawm, The Age of …-trilogie.

- 35 Voor zover ‘complex’ en ‘niet-triviale architectuur’ niet al synoniem zijn.

- 36 Op dit punt, en de eronder genoemde integriteit van uitkomsten, valt ook het nodige toe te voegen aan bepaling hoe en hoeveel human in the loop nodig is (bovenop de Europese minimumvereisten daaraan, en aan uitlegbaarheid en andere privacy-aspecten).

- 37 Nota bene; Ibn Battoeta (<deze link>) meldde reeds dat in 13e, 14e eeuws China het al heel gewoon was dat álle reizigers van herberg naar herberg werden ‘begeleid’ en óveral werden geregistreerd. Handmatig. Voorwaar iets om RPA op los te laten, heden ten dage … En degenen die laatstertijd ‘strijden’ (heel hard, met duimpjes en zo) tegen het huidige systeem aldaar, of hier, lopen dus wat achter (daar, en hier).

- 38 Naast het stasis-gericht giswerk dat subalterne, semi-, quasi- en overheidsbestuurders nu al wordt verweten.

- 39 Maar wat aanklungelen met een ‘Heads I win, Tails you lose’ afschuifmentaliteit wordt in het bedrijfsleven (steeds meer, hoewel nog veel te weinig) bestraft met ontslag, clawbacks en VoG-beroepsontzegging. Grove onachtzaamheid zou ook in publieke omgevingen zo kunnen worden aangepakt. Alleen de juiste (sic) skin in the game (Taleb) helpt tegen verkeerd gerichte incentives en moral hazard, blijkt onwrikbaar keer op keer.

- 40 Zie net als het vorige deel <deze link> wat die gaan doen… De ruimte die dan blijft voor geniale stuurkunsttalenten als de grote en wijze filosoof, auteur van deze blogpost (zie <deze link>) is duidelijk. Zie ook eindnoot 50 [voor de recursie].

- 41 Zie <deze link> [1:20 en verder – maar de hele clip is top].

- 42 Het is de vraag of de LIDARs et al ooit snel genoeg zo kleine objecten zullen kunnen identificeren – of het gaat om het studentikoze soort waar vele chauffeurs niet voor zouden willen uitwijken.

- 43 Achter de voorruit is Netflix én chill een beetje … transparant…

- 44 Want we willen worden vermaakt, blijkt: <deze link> en <deze link>, en bovendien zakt onze aandacht toch al héél snel weg: <deze link>. En dan is ook <deze link> net binnen…

- 45 Voor dit en andere vertrouwensaspecten, zie Vehicle-to-Vehicle communicatie; weg van de privacy? IB Magazine #4, 2020. Zie tevens Hacker Gehackt, IB Magazine #5, 2020. En ook <hier>

- 46 De default zal immers zijn ingesteld op méér informatie.

- 47 Voor nooddiensten zou dit weleens een aardige winst kunnen opleveren. Mits er niet te veel ‘overige’ weggebruikers zijn die denken handig gebruik te kunnen maken van de plots geboden ruimte. Lastiger wordt het als allerlei maatschappelijk belangrijke beroepsgroepen ook (enige) voorrang krijgen. Zorgpersoneel, vuilophalers, gemeenteplantsoenendienstmedewerkers etc.; in dat geval komen politici nooit uit de parkeerstand. En zullen dan niet velen out-opten uit opname in de mesh en weer zelf willen rijden?

- 48 Ik ben geen kleuter-op-leeftijd (-30jr) noch hoogbejaard, ik heb een niet-elektrische.

- 49 Zoiets als <deze link> maar dan veel vaker uitgevoerd.

- 50 Zeker van de Nederlanders, Dunning-Krugerfetishisten die ze zijn, zal 90% van zichzelf denken tot de top-5% van de maatschappij te behoren. Wat nou enkeling? Zie ook eindnoot 40 [voor de recursie].

- 51 Zie <deze link>

- 52 <deze link>

- 53 Het is min of meer formeel gedocumenteerd, ergens, dus zouden sommigen het een feature noemen. Maar voor de gebruiker (de backup-chauffeur!) is dat niet leesbare commentaar dus een bug..?

- 54 Ook de cloud is slechts andermans servers die fysiek ergens staan

- 55 <deze link>

- 56 De Operational Technology in de Auto, maar buiten scope van dit artikel ook in ‘de’ fabriek. De ‘koppeling’ van OT aan kantoorautomatisering staat ook nog in de kinderschoenen, qua integrale beveiliging voorbij het geklungel met ‘PDCA’(quod non)-procedures op papier.

- 57 Zo zou het een fabrikant ook niet kunnen schelen dat verkeerd gedrag van één Saab-rijder in software-updates zou worden verwerkt en alle Saab-rijders meer agressief zou afstraffen. Zie ook eindnoot 67.

- 58 Men vreze dat dit zojuist verzonnen woord niet in de nieuwste Van Dale is opgenomen.

- 59 Eerst was het: <deze link> maar ook toen was er al <deze link>, waarna Musk in <deze link> moest terugkrabbelen

- 60 Dan is het range-probleem (sic) nog triviaal. Hoorde van een collega die op weg naar de Zuid-Franse kust zelfs een overnachting+ moest nemen om op te laden… Zelf heb ik aan tien minuten tanken wel genoeg (en hooguit één tankbeurt naar Cap d’Agde); ik neem pauze’tjes voor mijn eigen plezier ja. Eerst maar eens dit soort simpele problemen oplossen voor (!) we massaal overstappen op e-alles?

- 61 Met enige regelmaat komen er fraaie verhalen de wereld inzeilen, maar serieuze analyses gooien die verhalen telkens weer van tafel.

- 62 Zie <deze link> /li>

- 63 Wie denkt dat zhij begrijpt hoe non-discriminatie- en ethische afwegingen in AI zouden moeten, kan <deze link> bestuderen en oefenen. Eenduidige antwoorden zijn er niet.

- 64 Zie ook eindnoot 67.

- 65 Gelukkig dat Heisenberg’s Onzekerheidsprincipe op deze schaal niet van toepassing is. Voor de jeugdige lezers: Dit betreft Heisenberg de gigant in de theoretische fysica, niet die verheerlijkte crimineel van de Netflix-serie.

- 66 Hierin zit dus een hint: Vertrouw niet te veel op centraal verzamelde omgevingsdata! Maar ja, die zijn wel de basis voor routeberekeningen en het ‘plaatsen’ van gedetecteerde objecten. Of moet ‘alle’ omgevingsdetectie dan maar altijd opnieuw ter plekke worden gedaan door iedere zelfrijdende Auto ..?

- 67 Ervaringsfeit van ondergetekende; geen Saab-fan.

- 68 Tsja, ook gewoon programmeerwerk met Let, If-Then en Jump. Dat zijn de enige primitieven die nodig zijn ..! Ook Call-Return, While, For-Next, … u noemt ze maar, zijn herleidbaar tot die drie. Ook dit soort ‘programma’s’ implementeren algoritmen! Dat de wereld zich de laatste vijf jaar zo druk maakt met het toezicht op ‘algoritmes’, is dus een halve eeuw te laat. Laten we hopen dat er in al die (overheids- en andere) systemen niet al te veel discriminatie is verwerkt.

- 69 Na de jaren 50-70 en eind jaren ’90.

- 70 Noem eens een systeem waar de overheid niet in discrimineert. Nee, die ook.

- 71 Social media krijgen betaald voor uw gegevens, dús zijn ze wat waard. Wat ziet u ervan terug? Verkokering (filter bubble)? Dat is inbreuk op privacy want de keuzevrijheid belemmerend…

- 72 Dat eindelijk ontmaskerd is als nauwelijks verholen opvolger van Operations Research en daarvoor Scientific Management: Alles voor het terugdringen van afwijkingen, terwijl de klant juist meer flexibiliteit blijft vragen.

- 73 Zie bijvoorbeeld <deze link>

- 74 Zie <deze link>van zeven jaar terug, bijvoorbeeld…

- 75 Zie zeker ook Mischa de Haan’s Zeg nee tegen autonoom rijden, hier: <deze link>

- 76 Wetende dat tot in de meest biodynamische methoden het platspuiten met kopersulfaat gewoon ‘mag’. Da’s vreemd hè, want kopersulfaat is best agressief chemisch en vervuilt de bodem.

- 77 Eenieder die weet wat proeven inhoudt, weet dat niet ‘drinken’ laat staan ‘grote hoeveelheden drinken’ bedoeld is!